API-Schema-Validierung mit OpenAPI und XSD meistern: Tipps für Tester

In der modernen Softwareentwicklung ist die Sicherstellung der Qualität von Datenformaten ein kritischer Erfolgsfaktor für Anwendungen. Hierbei kommt...

Praxisnah. Erfolgsbewährt. Maßgeschneidert. Erfahren Sie mehr über unsere Case Studies.

4 Min. Lesezeit

Alexander Morgner

:

Montag, 23.2.2026

Alexander Morgner

:

Montag, 23.2.2026

Lotterien schütten wöchentlich Millionenbeträge an glückliche Gewinner aus. Doch schon ein unscheinbarer Fehler in der Gewinnlogik kann eine Kostenlawine lostreten.

In klassischen Softwaresystemen wären solche Fehler ärgerlich. Im Lotterieumfeld erreichen sie existenzielle Dimensionen. Wo Millionen Transaktionen verarbeitet und automatisiert ausgeschüttet werden, entscheidet nicht nur funktionale Korrektheit über Qualität, sondern mathematische Robustheit. Klassische Testmethoden stoßen in hochkombinatorischen Systemen schnell an ihre Grenzen. Lotteriesoftware operiert nicht mit einzelnen Testfällen, sondern im Raum von Wahrscheinlichkeiten.

Bereits ein einfacher Spielschein „Lotto 6 aus 49" erzeugt 140 Millionen mögliche Zahlenkombinationen. Hinzu kommen Zusatzlotterien, Systemscheine, Mehrwochenspiele, variable Einsatzhöhen, Annahmeschlusszeiten, Rabattlogiken und Sonderauslosungen.

Manuelle Tests können hier nur exemplarisch prüfen. Sie validieren bewusst gewählte Szenarien. Die systematische Überprüfung statistischer Verteilungen oder seltener Randfälle bleibt außen vor. Das Risiko liegt auf der Hand. Fehler treten nicht dort auf, wo man sie erwartet. Sie entstehen in Konstellationen, die im klassischen Testdesign nie vorgesehen waren.

Moderner Testansatz setzt auf große Datenmengen statt einzelner Testfälle. Automatisiert generierte Spielscheine werden über reale Schnittstellen abgegeben, verarbeitet und statistisch ausgewertet. Entscheidend ist nicht, ob ein einzelner Spielauftrag korrekt validiert wird. Entscheidend ist, ob das Systemverhalten der mathematisch erwartbaren Verteilung entspricht.

Weichen Häufigkeiten signifikant von der theoretischen Erwartung ab, deutet dies auf systematische Fehler hin. Diese können im Zufallsalgorithmus, in Validierungsregeln oder in der Berechnungslogik von Einsätzen und Gewinnen liegen. Testing muss daher vom Einzelfallvergleich zur Verteilungsanalyse werden.

Die Sofortlotterie „Platin 7“ zeigt, wie schnell selbst mittlere Gewinnklassen ein Ausschüttungsvolumen in Millionenhöhe erreichen:

Bereits eine einzelne Gewinnklasse bewegt damit Beträge im oberen einstelligen Millionenbereich. Doch wo liegen die noch kritischeren Risiken? Ein häufiges Missverständnis legt den Fokus auf die Hauptgewinne. „Platin 7“ verteilt seinen Hauptgewinn auf sechs Rubbellose mit je 0,5 Millionen Euro, also 3 Millionen Euro. Der Vergleich zur Gewinnklasse 5 macht deutlich, dass sich hier entgegen aller Erwartung nicht das Worst-Case-Szenario verbirgt.

Tatsächlich besitzen die untersten beiden Gewinnklassen ein nochmals höheres Ausschüttungsvolumen, mit jeweils mehr als 20 Millionen Euro, obwohl die Einzelgewinne nur 10 bzw. 20 Euro betragen. Hier zeigt sich die inverse Logik der Risikoverteilung: Je kleiner der Einzelgewinn, desto größer kann aufgrund der hohen Trefferwahrscheinlichkeit das kumulierte Ausschüttungsvolumen werden.

Ein systematischer Fehler in diesen Klassen verursacht daher den größeren Schaden – bei deutlich höherer Trefferwahrscheinlichkeit und damit schnellerer Eskalation. Die Konsequenz: Fehler in Gewinnklasse 5 wären mit rund 9 Millionen Euro bereits geschäftsgefährdend. Fehler in den unteren Klassen jedoch vervielfachen dieses Risiko zusätzlich.

Eine fehlerhafte Konfiguration durch falsche Zuordnung oder Berechnungsfehler beträfe nicht Einzelfälle. Zehntausende Kunden wären betroffen. Der finanzielle Schaden summiert sich innerhalb kürzester Zeit zu Millionenbeträgen. Darüber hinaus steht das Vertrauen in die Systemintegrität auf dem Spiel – ein Reputationsverlust, der langfristig noch schwerer wiegt.

Nein. Wahrscheinlichkeitsrechnung ermöglicht belastbare Aussagen durch statistisch saubere Stichproben. Bei einer Sicherheit von über 99 Prozent (Konfidenzniveau) und üblicher Fehlertoleranz reichen bereits etwa 2.500 automatisierte Loskäufe, um mindestens 10 Treffer in Gewinnklasse 5 zu erzielen. Dabei sind zahlreiche Treffer in darunter liegenden Gewinnklassen bereits sichergestellt.

Bei „Platin 7“ entfallen auf die obersten drei Gewinnklassen lediglich 428 Lose. Die unteren fünf Klassen umfassen hingegen mehrere Millionen Gewinnfälle – über 99 Prozent aller Treffer sowie 95 Prozent der gesamten Ausschüttungssumme. Der Testfokus auf diese Klassen gewährleistet damit eine nahezu vollständige Abdeckung der realen Risikoverteilung. Damit lassen sich systematische Fehlkonfigurationen bereits mit wenigen Tausend Losen zuverlässig erkennen – ohne die gesamte Serie durchspielen zu müssen.

Lotteriesysteme unterliegen strikten Aufsichtsstandards. Die GGL (Gemeinsame Glücksspielbehörde der Länder) überwacht als deutsche Aufsichtsbehörde die Einhaltung regulatorischer Anforderungen. Zusätzlich gelten internationale Standards wie die der WLA (World Lottery Association).

Diese fordern nicht nur funktionale Korrektheit, sondern nachweisbare mathematische Fairness. Transparenz, Nachvollziehbarkeit und statistische Korrektheit sind keine optionalen Qualitätsmerkmale. Sie sind regulatorische Pflichtanforderungen. Fehler in Gewinnklassen oder Auszahlungslogiken ziehen nicht nur wirtschaftliche Schäden nach sich. Sie können aufsichtsrechtliche Konsequenzen auslösen wie Lizenzauflagen, Betriebsuntersagungen oder Strafen.

Statistische Testverfahren liefern den geforderten Nachweis. Sie erzeugen dokumentierte, reproduzierbare Aussagen über die Verteilungssicherheit des Systems. Compliance-Risiken werden somit zu planbaren, budgetierbaren Testaufwänden.

Aber erst durch Automatisierung wird dieser Ansatz praktikabel. Neben der reinen Geschwindigkeit wird zusätzlich ein weiterer zentraler Risikofaktor reduziert: menschliche Inkonsistenz. Bei der Dokumentation, Auswertung oder Übertragung großer Datenmengen stoßen manuelle Prüfungen zwangsläufig an ihre Grenzen. Automatisierte Verfahren liefern dagegen reproduzierbare Ergebnisse, konsistente Protokolle und objektive Auswertungen. Qualität wird dadurch nicht nur schneller, sondern auch messbarer.

Ein weiterer wesentlicher Effekt liegt in der Entlastung von Fachpersonal. Repetitive und zeitintensive Tätigkeiten wie das manuelle Spielen und Auswerten großer Datenmengen werden von automatisierten Prozessen übernommen. Testexpertinnen und -experten gewinnen dadurch Freiräume für anspruchsvollere Aufgaben: die Analyse komplexer Fehlerszenarien, die Bewertung regulatorischer Anforderungen oder die strategische Weiterentwicklung des Testdesigns. Automatisierung steigert somit nicht nur Effizienz, sondern auch die fachliche Qualität der Qualitätssicherung.

Tausende Rubbellose (oder andere Spielscheine) können innerhalb eines Werktages gekauft, verarbeitet, „gerubbelt“ und ausgewertet werden. Zugleich werden dabei die technischen Übertragungswege umfassend geprüft: von der Frontend-Eingabe über die Backend-Verarbeitung bis zur Rückmeldung an das Benutzerinterface.

Auch wirtschaftlich ist der Nutzen eindeutig. Statistisch fundierte, automatisierte Prüfverfahren sind kein zusätzlicher Kostenblock, sondern eine Form der Risikoversicherung mit klar kalkulierbarem Aufwand. Der Einsatz tausender Testdurchläufe steht in keinem Verhältnis zu den potenziellen Schäden durch systematische Fehlkonfigurationen in Gewinnklassen, Rabattlogiken oder Auszahlungsregeln.

Ein weiterer Vorteil automatisierter Methoden ist die Skalierbarkeit über Produktgrenzen hinweg. Die meisten Lotterieprodukte unterscheiden sich nur in wenigen Parametern. Tippzahlen, Gewinnwahrscheinlichkeiten, Einsatzlogik und Ausschüttungsstruktur lassen sich variabel modellieren und automatisiert prüfen. Jedes Produkt benötigt kein vollständiges neues Testset. Neue Sofortlotterie-Arten, Eurojackpot, Keno oder Sonderauslosungen lassen sich effizient in bestehende Prüfprozesse integrieren.

Property-based Testing definiert Eigenschaften, die für alle Varianten gelten müssen. Dazu zählen korrekte Einsatzberechnungen, gültige Zahlenbereiche und konsistente Ausschüttungslogiken. Automatisch generierte Variationen prüfen diese Eigenschaften über eine große Bandbreite möglicher Eingaben.

Einmal definierte Eigenschaften lassen sich auf neue Produkte übertragen. Dazu müssen nur die zugrunde liegenden Parameter angepasst werden. Aus einmaliger Modellierung wird ein skalierbares Grundgerüst.

Lotteriesysteme sind hochreguliert, wirtschaftlich sensibel und technisch komplex. Die GGL und internationale Standards wie die WLA setzen den regulatorischen Rahmen. Millionenvolumina pro Gewinnklasse und Echtzeitverarbeitung erhöhen das wirtschaftliche Risiko.

Klassische Tests prüfen Funktionen, aber stochastische Tests prüfen Verhalten im Maßstab.

Die Kombination aus automatisierter Datengenerierung, Wahrscheinlichkeitsanalyse und kontinuierlicher Überwachung schafft nicht nur höhere Testabdeckung. Sie reduziert konkret das Geschäftsrisiko und sichert regulatorische Compliance. In einem Umfeld, in dem einzelne Konfigurationsfehler Millionen bewegen, ist statistisches Testing keine methodische Spielerei. Es ist betriebswirtschaftliche Notwendigkeit und regulatorische Pflicht.

Das Kernargument lautet: Nicht der einzelne Testfall entscheidet über Qualität, sondern die statistische Stabilität des Systems. Mit automatisierter Stichprobenerzeugung lässt sich diese Stabilität messbar, skalierbar und auditierbar sicherstellen. Und das bei einem Bruchteil der Kosten einer manuellen Vollabdeckung.

Unsere Lotterie-Experten stehen Ihnen für ein unverbindliches Gespräch zur Verfügung.

Melden Sie sich.

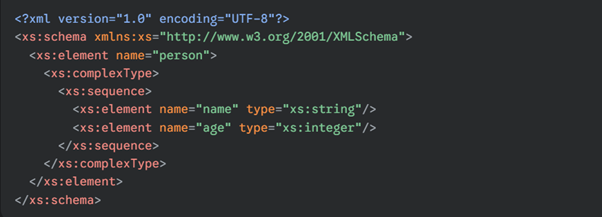

In der modernen Softwareentwicklung ist die Sicherstellung der Qualität von Datenformaten ein kritischer Erfolgsfaktor für Anwendungen. Hierbei kommt...

Warum wir diese Partnerschaft eingehen Softwarequalität ist ein Wettbewerbsvorteil unserer Kunden. Wer heute schneller, zuverlässiger und...

Für die Airline-Industrie sind Daten das Fundament der operativen Effizienz und der Kundenzufriedenheit. Die Migration von Data Warehouses (DWHs) in...